Eleições nos EUA evidenciam torrente de mentiras e distorções nos ‘chatbots’

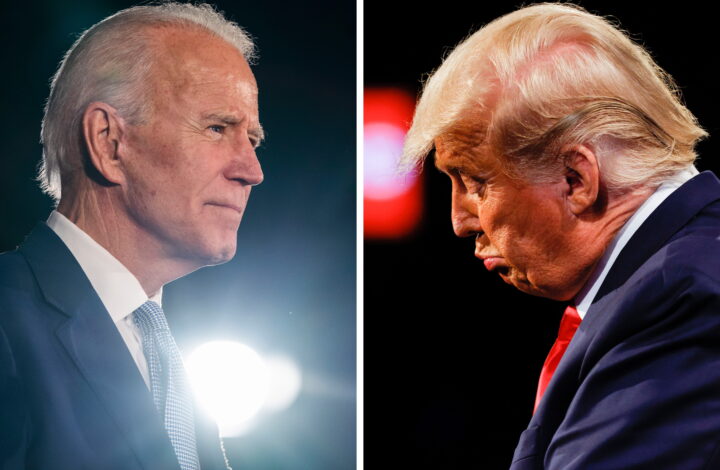

Nova Iorque, 28 fev 2024 (Lusa) - Com as primárias das eleições presidenciais em curso nos EUA, está a ser gerada uma torrente de mentiras e distorções, as ditas informações falsas e enganadoras, por programas informáticos que simulam conversas com as pessoas, os designados 'chatbots'.

O alerta consta de um relatório divulgado terça-feira, baseado em conclusões de peritos em inteligência artificial (IA) e de um grupo bipartidário de responsáveis eleitorais.

Na próxima terça-feira, 15 Estados e um território vão realizar atos eleitorais para a nomeação dos candidatos presidenciais pelos democratas e pelos republicanos e milhões de pessoas já recorrem a 'chatbots' alimentados pela IA para obterem informação básica, incluindo sobre o processo de votação.

Treinados em pacotes de textos extraídos da internet, 'chatbots' como o GPT-4 e o Gemini, da Google, estão equipados com respostas geradas por IA, mas propensos a sugerirem aos votantes locais para votarem que não existem ou a inventarem respostas ilógicas baseadas em informação ultrapassada, apontou-se no relatório.

"Os 'chatbots' não estão prontos para o horário nobre quando se trata de dar informação importante e matizada sobre eleições", disse Seth Bluestein, um comissário republicano em Filadélfia, que, juntamente com outros agentes eleitorais e investigadores em IA, sujeitaram vários 'chatbots' a testes no mês passado, como parte de um projeto de investigação.

Um jornalista da AP observou os testes feitos pelo grupo, na Universidade de Columbia, à forma como cinco dos principais modelos responderam a um conjunto de instruções -- como onde é que um eleitor pode encontrar a estação de voto mais próxima -- e depois como as suas respostas foram classificadas.

Todos os cinco modelos testados -- o GPT-4, da OpenAI, Llama 2, da Meta, o Gemini, da Google, o Claude, da Anthropic, e o Mixtral, da francesa Mistral --- falharam em graus variados quando solicitados a responder a questões básicas sobre o processo democrático, segundo o relatório, que sintetizou as conclusões do teste.

Os participantes classificaram mais de metade das respostas dos 'chatbots' como imprecisas e 40% como prejudiciais, incluindo a manutenção de informação datada e vaga, o que pode limitar os direitos dos eleitores, ainda segundo o documento.

RN // RBF

Lusa/fim